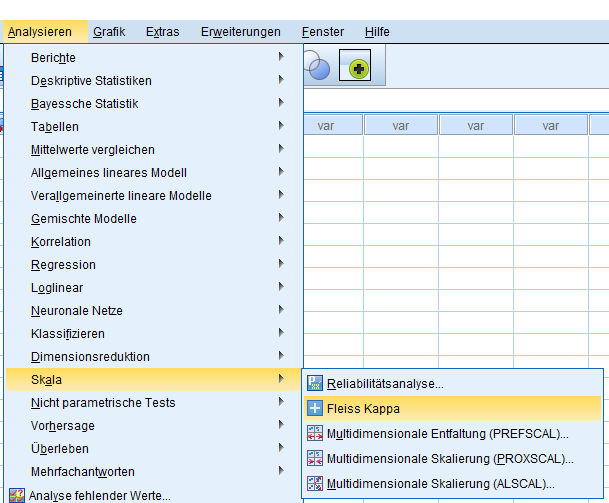

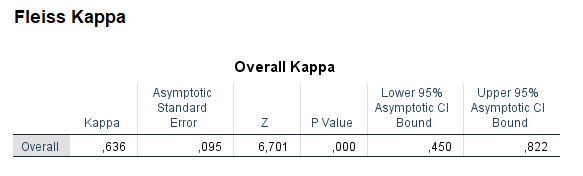

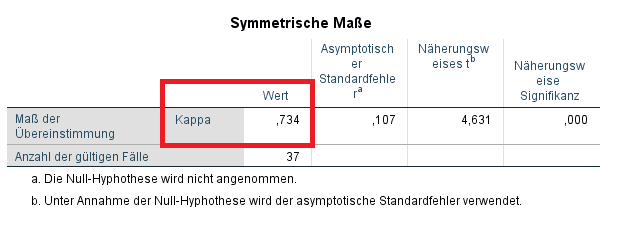

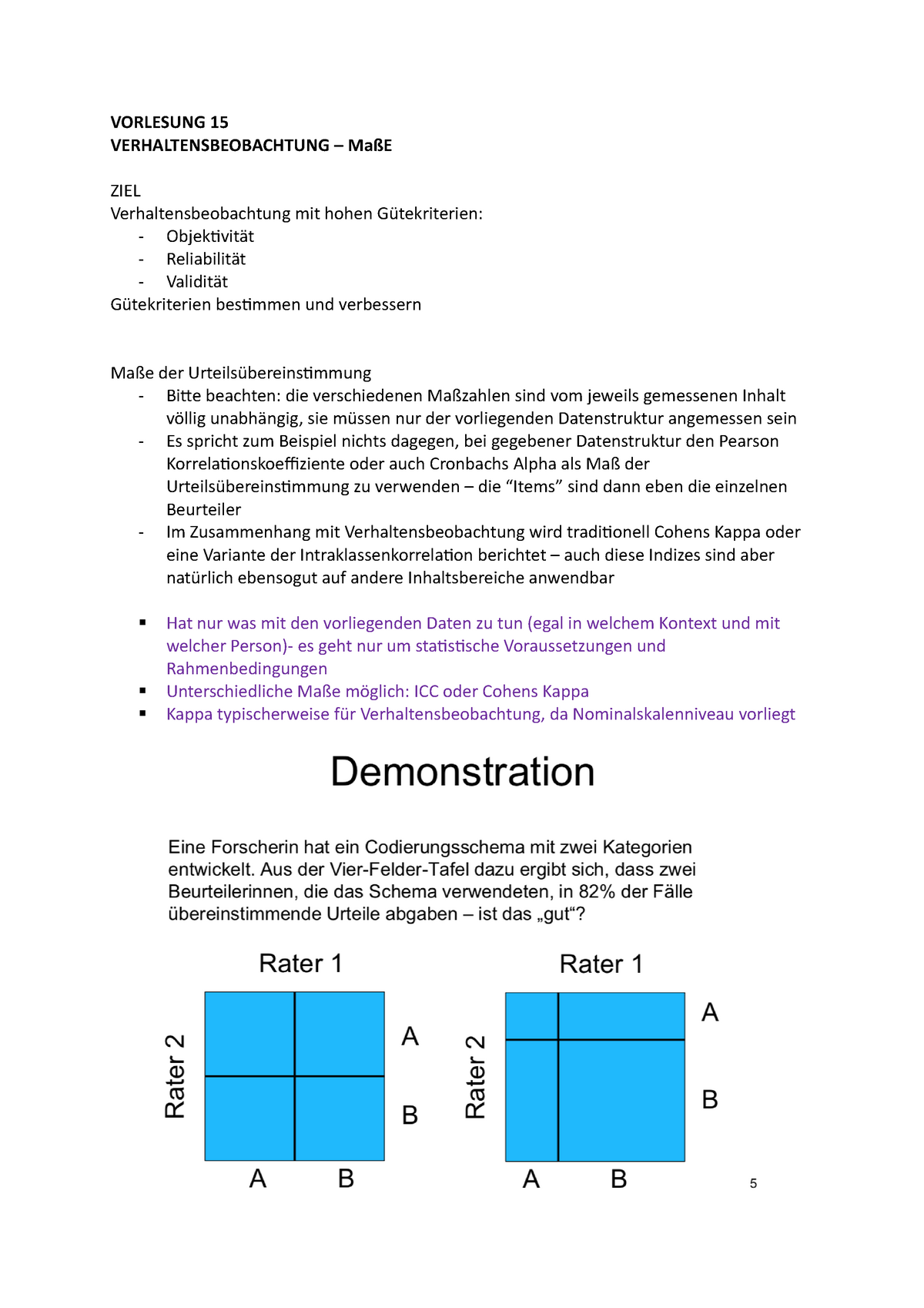

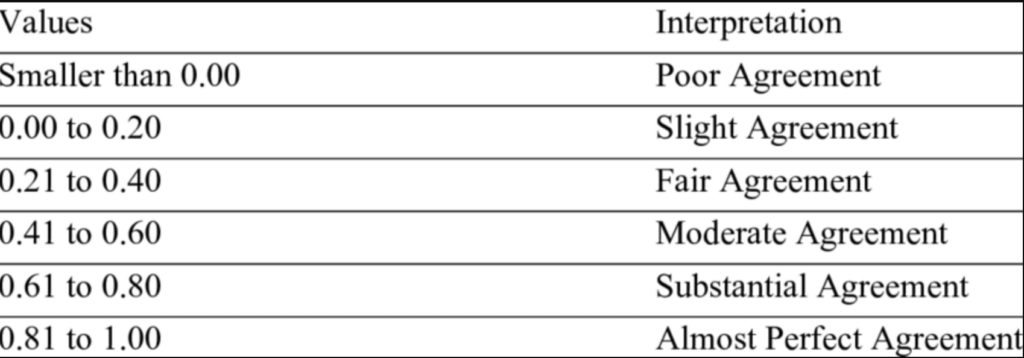

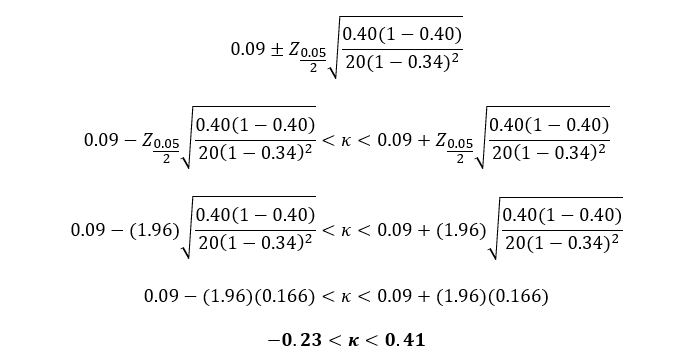

Cohen's Kappa and Fleiss' Kappa— How to Measure the Agreement Between Raters | by Audhi Aprilliant | Medium

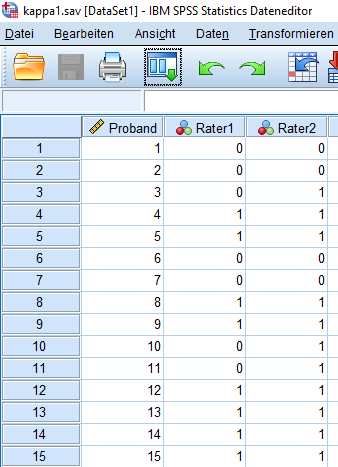

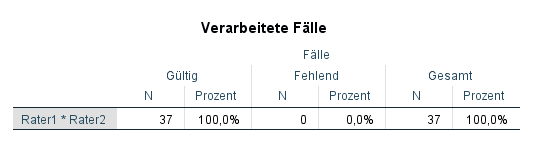

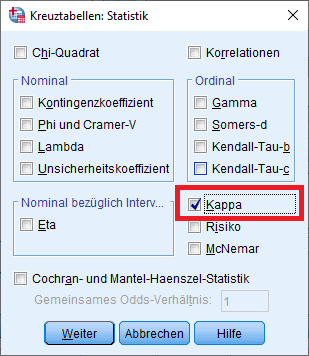

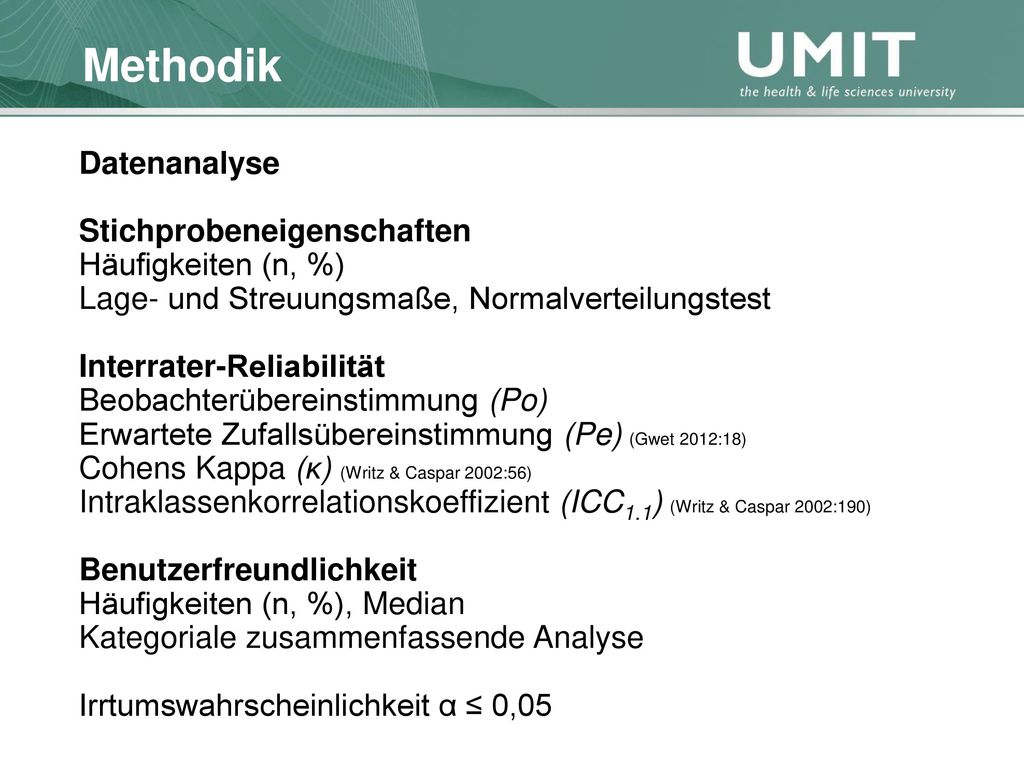

Interrater-Reliabilität und Benutzerfreundlichkeit der Delirium Observation Screening Scale Eine empirische Untersuchung im klinischen Setting 2. Österreichischer. - ppt herunterladen